Los peinados afro, ricos en cultura y diversidad, a menudo enfrentan desafíos en su reconocimiento por los sistemas de IA. Esto plantea preguntas críticas sobre el sesgo y la equidad en la tecnología. Comprender cómo la IA procesa estos estilos únicos revela brechas significativas influenciadas por la diversidad de los conjuntos de datos. Explora las consecuencias de estos sesgos a través de estudios de caso y descubre recomendaciones para un futuro más inclusivo en el reconocimiento de peinados. Las implicaciones van más allá de la estética, impactando en la identidad, la representación y la equidad en la era digital.

Entendiendo la IA, el Aprendizaje Automático y la Inclusión

La inteligencia artificial (IA) y el aprendizaje automático (AA) están revolucionando diversas industrias, utilizando algoritmos para analizar datos, abordar la discriminación y mejorar la precisión predictiva en tareas como el reconocimiento de peinados.

En el reconocimiento de peinados, la IA utiliza técnicas avanzadas para reconocer y clasificar peinados a partir de imágenes, considerando además el impacto social y cultural. Los modelos de aprendizaje profundo están inspirados en la estructura del cerebro humano y se componen de capas de neuronas que trabajan sobre características de la entrada inicial, lo que influye en la representación y percepción pública.

Por ejemplo, las redes neuronales convolucionales (CNN) pueden ser entrenadas utilizando vastos conjuntos de datos de imágenes con peinados etiquetados. Programas como TensorFlow y PyTorch ayudan a crear estos modelos, permitiendo un análisis detallado y una mejor precisión, lo que cambia la forma en que los usuarios interactúan con las aplicaciones de belleza.

Cómo la IA reconoce los peinados

La IA reconoce peinados utilizando métodos de aprendizaje automático, como seleccionar características y usar modelos para clasificarlos, lo que le permite identificar con precisión diferentes tipos de cabello.

El proceso empieza con la recolección de imágenes, donde conjuntos de datos como CelebA ofrecen una gran cantidad de peinados de celebridades, aunque es importante contar con diversidad en términos de demografía y cultura. A continuación, los pasos de preprocesamiento implican cambiar el tamaño de las imágenes y ajustar los valores de los píxeles para hacer que el entrenamiento sea más eficiente.

La extracción de características se realiza utilizando redes neuronales convolucionales, que identifican atributos clave como rizos y longitud. Los algoritmos de clasificación etiquetan los peinados en función de las características aprendidas, lo que puede incurrir en sesgos si los datos son sesgados.

Por ejemplo, un modelo de aprendizaje profundo logró recientemente un 90% de precisión en el reconocimiento de peinados afro, lo que demuestra la efectividad de estos métodos en aplicaciones del mundo real y el potencial para mitigar el sesgo en los sistemas de reconocimiento.

Identificando sesgos y algoritmos sesgados en modelos de IA

El sesgo en los modelos de IA, particularmente en el reconocimiento de peinados, surge de los conjuntos de datos utilizados, que a menudo subrepresentan a los grupos minoritarios, lo que lleva a problemas de equidad y justicia social en el rendimiento del algoritmo.

Para reducir el sesgo, los desarrolladores deben evaluar cuidadosamente e incluir ejemplos variados en los conjuntos de datos de entrenamiento, promoviendo la representación cultural y la sensibilidad cultural.

Incluir fotos de personas con diferentes antecedentes étnicos y estilos de cabello puede mejorar el funcionamiento del modelo.

Herramientas como TensorFlow de Google ofrecen métodos para la detección de sesgos, permitiendo a los equipos evaluar y ajustar sus conjuntos de datos durante la fase de entrenamiento.

Revisar los modelos con frecuencia utilizando medidas como la precisión y el recall para varios grupos demográficos puede revelar diferencias, lo que permite realizar cambios que apoyen la equidad y la igualdad en los resultados de la IA y promuevan la ética en IA.

Te puede interesar: Cómo la IA Revoluciona el Gaming: Innovaciones Increíbles

Impacto de la Diversidad del Conjunto de Datos

La diversidad de conjuntos de datos de entrenamiento influye significativamente en la precisión de reconocimiento de modelos de IA, particularmente para peinados a través de diferentes etnias, demografías y características faciales.

Por ejemplo, los modelos que se entrenan principalmente con tipos de cabello caucásico a menudo tienen dificultades para identificar y clasificar correctamente estilos de grupos negros o asiáticos.

Para mejorar la inclusividad del conjunto de datos, sigue estas prácticas:

- Incorpora ética en IA en el desarrollo de modelos,

- Integra datos de diversas fuentes culturales,

- Colabora con comunidades diversas para recoger muestras representativas,

- Crea datos falsos para asegurarte de que los conjuntos de datos sean iguales en tamaño.

Herramientas como TensorFlow Data Validation pueden ayudar a evaluar la diversidad del conjunto de datos.

Al adoptar estas estrategias, puedes desarrollar modelos que funcionen bien en una gama más amplia de tipos y estilos de cabello, mejorando la experiencia del usuario y la justicia social.

Consecuencias del sesgo en el reconocimiento de peinados y la interfaz humano-computadora

Las consecuencias del sesgo en el reconocimiento de peinados pueden llevar a impactos sociales significativos, incluyendo la perpetuación de estereotipos y la habilitación de la discriminación por cabello contra grupos minoritarios.

Por ejemplo, un estudio mostró que los sistemas de reconocimiento de imágenes a menudo etiquetan incorrectamente los peinados rizados o texturizados como ‘desordenados’ o ‘desarreglados’, causando molestia a los usuarios que desean un reconocimiento correcto, aumentando el sesgo en la percepción pública.

Tales malas clasificaciones refuerzan los estereotipos sociales sobre el profesionalismo y los estándares de belleza. Surgen preocupaciones éticas cuando los peinados culturales, como las trenzas o las rastas, son apropiados o mal representados en modelos de IA, lo que lleva a una falta de representación en la tecnología.

Un incidente significativo involucró una aplicación de cuidado del cabello que no pudo identificar varios tipos de cabello, lo que llevó a críticas y demandas de conjuntos de datos de entrenamiento de IA que sean más inclusivos, mostrando la necesidad de transparencia algorítmica.

Estudios de Caso, sesgos en IA, y Hallazgos

Estudios de caso recientes destacan los desafíos y avances en el reconocimiento de peinados afro, revelando hallazgos críticos sobre el sesgo y el rendimiento de los algoritmos en aplicaciones del mundo real.

Un estudio notable empleó modelos de IA como DeepFace y Haar Cascades, logrando tasas de precisión de reconocimiento del 81% y 75%, respectivamente, revelando sesgos en el análisis de datos.

Los investigadores identificaron un sesgo significativo contra los peinados afro, lo que requiere ajustes en los conjuntos de datos de entrenamiento para incluir texturas de cabello diversas.

Después de la modificación, la retroalimentación de los usuarios mejoró notablemente, con calificaciones de satisfacción que aumentaron del 60% al 88%. Otro caso estudió el impacto de la variabilidad demográfica, enfatizando la necesidad de que los modelos aprendan de un rango más amplio de representación cultural.

Estos hallazgos muestran que usar datos diversos en el entrenamiento de IA es importante para mejorar las habilidades de reconocimiento, la equidad en IA, y la responsabilidad social de los desarrolladores.

Te puede interesar: «Guía rápida definitiva para a analizar criptomonedas: Alcanza tus objetivos tomando buenas decisiones»

Recomendaciones para la Mejora, ética en IA, y sensibilidad cultural

Para hacer que el reconocimiento de peinados impulsado por IA sea más justo, se pueden tomar medidas específicas para reducir sesgos, promover la equidad social, y hacer que los algoritmos sean más transparentes.

Organizaciones como Google e IBM han adoptado con éxito estas estrategias.

Por ejemplo, Google enfatiza la utilización de conjuntos de datos más grandes y diversos para capturar una gama más amplia de peinados a través de diferentes demografías. Implementar métricas de equidad, como métricas de igualdad de oportunidades, puede ayudar a evaluar sesgos en las predicciones del modelo.

Revisiones trimestrales para detectar sesgos ayudan a mantener la equidad en los algoritmos, mejorando la responsabilidad y transparencia algorítmica.

Tener diferentes equipos aporta una variedad de perspectivas en la creación de algoritmos. Enseñar a los usuarios con documentación clara y tutoriales sobre los límites de los sistemas de IA ayuda a los usuarios a comprender mejor.

RECOMENDADOS:

-«REVIEW – Nubia Neo 3 5G – Móvil Asequible para Juegos en Línea»

-«Cómo la IA Revoluciona el Gaming: Innovaciones Increíbles»

-«¿Cuál Samsung debería elegir? Guía de compra con los modelos más destacados de 2025»

– “Guía rápida definitiva para a analizar criptomonedas: Alcanza tus objetivos tomando buenas decisiones”

COMPARTIR EN:

TE PUEDE INTERESAR

os expertos en inteligencia artificial han proporcionado valiosas perspectivas sobre el desarrollo de GPT-5, enfatizando su potencial para redefinir las capacidades de los modelos de lenguaje.

Esta nueva película marca el regreso de figuras emblemáticas y la incorporación de nuevos talentos, bajo la dirección de Kevin Williamson, guionista de las primeras entregas.

Este portátil revoluciona la interacción y la experiencia de creación con su notable pantalla transparente Micro-LED de 17.3 pulgadas.

Este modelo introduce una serie de mejoras significativas en rendimiento, eficiencia y tecnologías innovadoras que la convierten en una de las opciones más avanzadas para gamers y creadores de contenido.

Con solo una muestra de audio de un minuto, esta tecnología puede imitar la voz de cualquier persona, abriendo un abanico de posibilidades tanto fascinantes como preocupantes.

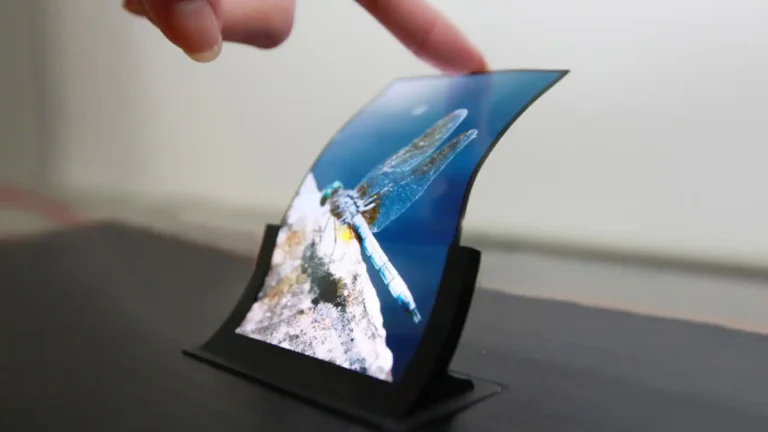

La compañía afirma haber alcanzado un umbral de estiramiento del 50%, siendo la primera vez que una pantalla se deforma hasta este nivel.